使用IDEA搭建Hadoop開發環境的操作步驟(Window10為例)

下載安裝包

進入官網下載下載hadoop的安裝包(二進制文件)http://hadoop.apache.org/releases.html

我們這里下載2.10.1版本的,如果想下載更高版本的請先去maven倉庫查看是否有對應版本

解壓文件下載好的.gz文件可以直接解壓。

winRAR和Bandizip都可以用來解壓,但是注意必須以管理員身份打開解壓軟件,否則會出現解壓錯誤

配置環境變量配置JAVA_HOME和HADOOP_HOME

我們在環境變量處分別設置JAVA_HOME和HADOOP_HOME

然后在Path里添加JAVA和hadoop的二進制文件夾,bin文件夾

打開你的cmd,輸入以下命令,出現我這樣的輸出說明配置環境變量成功:

C:Userslenovo>hadoop -version

HDFS配置

來到之前解壓的hadoop文件夾下,打開etc/hadoop文件夾

現在我們的任務就是修改這些文件當中的代碼,務必修改,不然根本無法運行hadoop!!

修改 hadoop-env.cmd

將configuration處更改為:

<configuration> <property> <name>fs.defaultFS</name> <value>hdfs://0.0.0.0:9000</value> </property></configuration>

修改 hdfs-site.xml

將configuration處更改為如下所示,其中file:///E:/DevTols/hadoop-2.10.1/namespace_logsfile:///E:/DevTols/hadoop-2.10.1/data這兩個文件夾一定需要是已經存在的文件夾,你可以在你的hadoop文件夾下隨意創建兩個文件夾,然后將下面的這兩個文件夾的絕對路徑替換成你的文件夾,這里我也是創建了兩個新的文件夾,hadoop的下載文件夾里本身是沒有的。

將configuration標簽及內容替換為

<configuration> <property> <name>dfs.replication</name> <value>1</value> </property> <property> <name>dfs.name.dir</name> <value>file:///E:/DevTols/hadoop-2.10.1/namespace_logs</value> </property> <property> <name>dfs.data.dir</name> <value>file:///E:/DevTols/hadoop-2.10.1/data</value> </property></configuration>

修改 mapred-site.xml

將下方的%USERNAME%替換成你windows的用戶名用戶名可以通過win鍵查看

<configuration> <property> <name>mapreduce.job.user.name</name> <value>%USERNAME%</value> </property> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> <property> <name>yarn.apps.stagingDir</name> <value>/user/%USERNAME%/staging</value> </property> <property> <name>mapreduce.jobtracker.address</name> <value>local</value> </property></configuration>

注意以上代碼有兩個地方的%USERNAME%需要替換,不要漏了!!!

修改 yarn-site.xml

<configuration> <property> <name>yarn.server.resourcemanager.address</name> <value>0.0.0.0:8020</value> </property> <property> <name>yarn.server.resourcemanager.application.expiry.interval</name> <value>60000</value> </property> <property> <name>yarn.server.nodemanager.address</name> <value>0.0.0.0:45454</value> </property> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <property> <name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name> <value>org.apache.hadoop.mapred.ShuffleHandler</value> </property> <property> <name>yarn.server.nodemanager.remote-app-log-dir</name> <value>/app-logs</value> </property> <property> <name>yarn.nodemanager.log-dirs</name> <value>/dep/logs/userlogs</value> </property> <property> <name>yarn.server.mapreduce-appmanager.attempt-listener.bindAddress</name> <value>0.0.0.0</value> </property> <property> <name>yarn.server.mapreduce-appmanager.client-service.bindAddress</name> <value>0.0.0.0</value> </property> <property> <name>yarn.log-aggregation-enable</name> <value>true</value> </property> <property> <name>yarn.log-aggregation.retain-seconds</name> <value>-1</value> </property> <property> <name>yarn.application.classpath</name> <value>%HADOOP_CONF_DIR%,%HADOOP_COMMON_HOME%/share/hadoop/common/*,%HADOOP_COMMON_HOME%/share/hadoop/common/lib/*,%HADOOP_HDFS_HOME%/share/hadoop/hdfs/*,%HADOOP_HDFS_HOME%/share/hadoop/hdfs/lib/*,%HADOOP_MAPRED_HOME%/share/hadoop/mapreduce/*,%HADOOP_MAPRED_HOME%/share/hadoop/mapreduce/lib/*,%HADOOP_YARN_HOME%/share/hadoop/yarn/*,%HADOOP_YARN_HOME%/share/hadoop/yarn/lib/*</value> </property></configuration>

初始化環境變量

在windows下的cmd,輸入cmd的命令,用于初始化環境變量。

%HADOOP_HOME%etchadoophadoop-env.cmd

格式化文件系統

這個命令在整個hadoop的配置環境和之后的使用當中務必僅使用一次!將如下的命令輸入到cmd當中進行格式化:

hadoop namenode -format

會彈出一大堆指令,只要看到其中有如下提示,就說明格式化成功

INFO common.Storage: Storage directory E:DevTolshadoop-2.10.1namespace_logs has been successfully formatted.

向hadoop文件當中注入winutills文件

由于windows下想要開啟集群,會有一定的bug,因此我們去網站:https://github.com/steveloughran/winutils下載對應版本的winutils.exe文件。打開這個Github倉庫后如下所示:

我們打開hadoop2.8.3/bin,選擇其中的winutils.exe文件進行下載,然后將下載的這個文件放入到本地的hadoop/bin文件當中。不然的話,你打開一會兒你的偽分布式集群,馬上hadoop就會自動關閉,缺少這兩個文件的話。

向hadoop文件當中添加hadoop.dll文件

hadoop.dll文件是啟動集群時必須的,如果在安裝過程中悲催地發現/bin目錄下沒有該文件(比如博主),就需要去網上自學下載該文件。進入網頁https://github.com/4ttty/winutils,根據箭頭所指步驟下載hadoop.dll文件

下載完成后,把文件添加到/bin目錄

開啟hadoop集群

在cmd當中輸入

%HADOOP_HOME%/sbin/start-all.cmd

這樣就會跳出來很多黑色的窗口,如下所示:

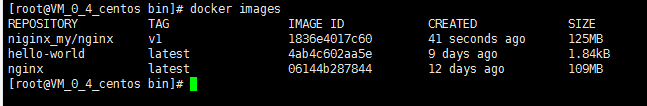

然后可以使用JPS工具查看目前開啟的node有哪些,如果出現namenode,datanode的話說明集群基本上就成功了。如下所示:

打開本地瀏覽器進行驗證

我們在瀏覽器輸入localhost:50070,如果能夠打開這樣的網頁,說明hadoop已經成功開啟:

IDEA 配置

歷經千辛萬苦我們總算安裝完Hadoop了,下面在IDEA上用maven配置hadoop

創建MAVEN項目工程

打開IDEA之后,里面的參數和項目工程名稱隨便寫,等待工程創建完畢即可。然后我們編輯pom.xml文件

<?xml version='1.0' encoding='UTF-8'?><project xmlns='http://maven.apache.org/POM/4.0.0' xmlns:xsi='http://www.w3.org/2001/XMLSchema-instance' xsi:schemaLocation='http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd'> <modelVersion>4.0.0</modelVersion> <groupId>com.atguigu</groupId> <artifactId>hdfs1205</artifactId> <version>1.0-SNAPSHOT</version> <properties><maven.compiler.source>8</maven.compiler.source><maven.compiler.target>8</maven.compiler.target> </properties> <dependencies><dependency> <groupId>junit</groupId> <artifactId>junit</artifactId> <version>RELEASE</version></dependency><dependency> <groupId>org.apache.logging.log4j</groupId> <artifactId>log4j-core</artifactId> <version>2.8.2</version></dependency><dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-common</artifactId> <version>2.10.1</version></dependency><dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-client</artifactId> <version>2.10.1</version></dependency><dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-hdfs</artifactId> <version>2.10.1</version></dependency> </dependencies></project>

點擊右下方的auto-import,自動安裝jar包。完成后左側External Libraries可以看到添加了很多個jar包,如下圖

這樣就說明我們導入maven倉庫成功了。

編寫log4j.proporties配置文件

在src/main/resources目錄下創建log4j.proporties文件,編寫如下代碼

log4j.rootLogger=debug, stdout, Rlog4j.appender.stdout=org.apache.log4j.ConsoleAppenderlog4j.appender.stdout.layout=org.apache.log4j.PatternLayout# Pattern to output the caller’s file name and line number.log4j.appender.stdout.layout.ConversionPattern=%5p [%t] (%F:%L) - %m%nlog4j.appender.R=org.apache.log4j.RollingFileAppenderlog4j.appender.R.File=example.loglog4j.appender.R.MaxFileSize=100KB# Keep one backup filelog4j.appender.R.MaxBackupIndex=5log4j.appender.R.layout=org.apache.log4j.PatternLayoutlog4j.appender.R.layout.ConversionPattern=%p %t %c - %m%n編寫Java文件

終于到最后一步了,編寫java文件并執行別忘了先hadoop偽分布式集群!!!cmd中編寫%HADOOP_HOME%/sbin/start-all.cmd

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.FileStatus;import org.apache.hadoop.fs.FileSystem;import org.apache.hadoop.fs.Path;import java.net.URI;public class Test { public static void main(String[] args) throws Exception {FileSystem fs = FileSystem.get(new URI('hdfs://127.0.0.1:9000'), new Configuration());FileStatus[] files = fs.listStatus(new Path('/'));for (FileStatus f : files) { System.out.println(f);}System.out.println('Compile Over'); }}

這段代碼的含義是遍歷hadoop文件系統(HDFS)下的root下所有文件的狀態,并輸出

完成以后在cmd輸入%HADOOP_HOME%/sbin/start-all.cmd關閉偽集群

為了方便可以配置%HADOOP_HOME%/sbin/start-all.cmd和%HADOOP_HOME%/sbin/start-all.cmd的環境變量,這里不再贅述,留給讀者發揮。

到這里Window10下使用IDEA搭建開發環境就完成了,撒花!!!

到此這篇關于Window10下使用IDEA搭建Hadoop開發環境的文章就介紹到這了,更多相關IDEA搭建Hadoop開發環境內容請搜索好吧啦網以前的文章或繼續瀏覽下面的相關文章希望大家以后多多支持好吧啦網!

相關文章:

網公網安備

網公網安備